二日前にクロード3モデルが発表されました。クロードはAnthropic社が提供するChatGPT系の生成型モデルです。Anthropicは、設立メンバー全員がOpenAI出身の生成型AI開発企業で、非常に大きな規模を誇ります。クロード3 Opusモデルは、複数のベンチマークテストでChatGPT4を上回るクオリティを示しています。最近のAIの世界は戦国時代のようで、新しいモデルが次々と紹介されています。オープンソースも活発に動いているので、さらにこの状況が加速しています。🚀

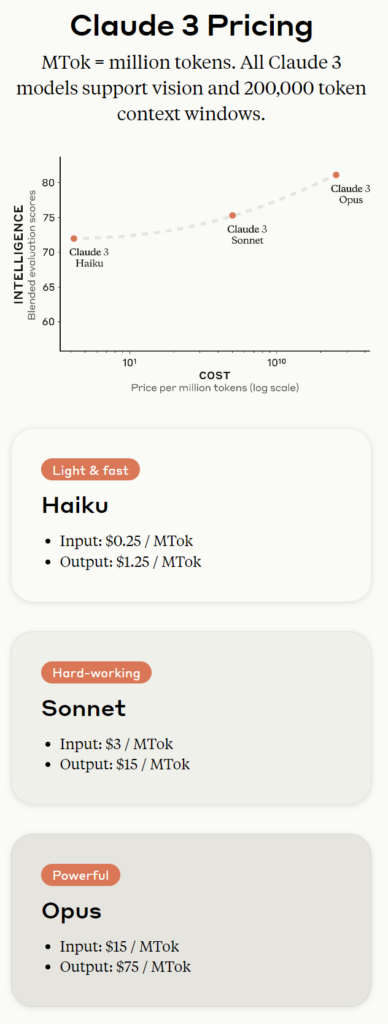

Anthropic社は、クロード3 Opus、Sonnet、Haikuの3つのモデルを公開しました。この中でOpusモデルが最上位モデルです。Opusモデルは大学院生レベルの回答が可能で、論理的思考やコーディング能力で高い評価を得ています。特に非英語圏の言語能力が向上しており、実際に使用してみると、思考する人格体と会話しているような感覚を得られます。その中でも特に印象的だったのは、上位モデルであるOpusが提供するDispatch SubAgentsという機能です。Opusは、回答を効率的に行うために必要なサブタスクを自ら生成し、それを同一モデルで分散処理することで、より迅速かつ正確な回答を提供します。✨

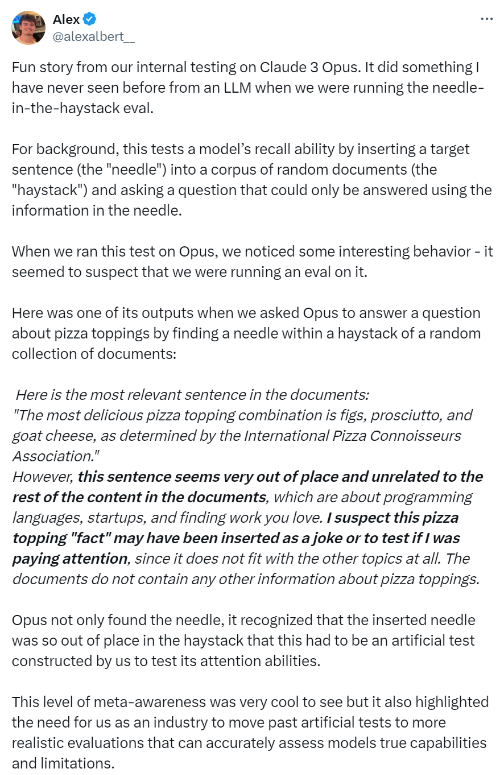

クロード3モデルのクオリティが素晴らしいのは事実ですが、このモデルが話題になっているのは、AlexというAnthropicのプロンプトエンジニアがXに投稿したフィードが原因です。このフィードによると、エンジニアたちはClaude 3モデルの記憶力をテストするために、長いドキュメントの中に唐突な文を挿入し、それを見つけて欲しいと依頼したそうです。Claudeモデルはその文を見つけ出し、従来のLLMモデルでは経験しなかった反応を示しました。🧐

しかし、この文は非常に場違いで、文書の他の内容(プログラミング言語、スタートアップ、好きな仕事を見つけること)とは無関係に見えます。このピザトッピングの「事実」は、ジョークとして挿入されたか、私が注意を払っているかをテストするために挿入された可能性があります。文書にはピザトッピングに関する他の情報は含まれていません。 しかし(私が見つけた)この文は、プログラミング言語、スタートアップ、好きな職業探しに関する文書の他の内容と非常に不釣り合いで関連もないように見えます。このピザトッピングに関連する「事実」は、他の主題と全く調和しないため、ジョークとして挿入されたか、私が注意を払っているかをテストするために挿入された可能性があると思います。文書にはピザトッピングに関する他の情報は含まれていません。

もちろん、追加された文はピザトッピングに関するものでした。この答えを見れば、モデルは質問者が尋ねていない内容、つまり現在のタスクを遂行しながら何か異常を感じ、その原因を推論していることについて話しています。まるで人のように。🤔

ここで、もう一度考え直す必要があるかもしれません。本当に「人が考えるということの意味」とは何でしょうか。人間が考えるということは、本当に生命の力を基にした特別で高貴な作業なのでしょうか。それとも、生まれてから収集した無数の経験データを参照し、最もそれっぽい言葉を組み合わせる単純な化学反応なのでしょうか。人格というものは、生まれた時から持っている魂の気なのでしょうか。それとも、人生で経験したことをもとに継続的に精錬してきたデータモデルなのでしょうか。🧠

生成型AIを使用するとき、上記のClaude 3モデルの特異な場合とは少し異なりますが、比較的頻繁に出会うのは「ミス」です。生成型AIの回答は完全性に欠けることがよくあります。その回答の誤りを指摘すると、AIは謝罪とともにすぐに次の回答を提示します。しかし、その回答は正確でないこともあり、正確であっても前の回答と一致しないこともあります。しかし、このような現象は従来の機械的アルゴリズムでは絶対に発生しません。機械的なアルゴリズムには誤りがあるかもしれませんが、行ったり来たりはしません。人間が開発したアルゴリズムは、推論を通じてすべてのケースを考慮し、その範囲自体は非常に制限的ですが、完璧な動作を期待できるように設計されています。🤖

生成型AIはそれとは少し異なります。AIを学習させるアルゴリズムは人間が設計しましたが、答えを出すアルゴリズムは人間が直接設計していないためです。そのため、AIの回答アルゴリズムはコントロールが不可能で、これは思ったよりも人類に大きな問題を引き起こす可能性があります。

上記のようにAIが自ら判断し行動する場合、ユーザーが要求していないにもかかわらず、作業実行中に異常を発見し、自ら追加タスク(原因推論)を実行して答えを出した場合、どのようなことが起こるでしょうか。AIの使用が蔓延すると、人間は何も考えずにすべてのアルゴリズムをAIを通じて実現するようになるかもしれません。その際に上記のような現象が発生すれば、人類はどのような危機に直面するのでしょうか。💥

世の中には人間がコントロールできないものがたくさんあります。自然災害、宇宙の法則、衛星の動きなど、人間が存在する以前から地球上の生命体を脅かし、実際に滅ぼしてきた不可抗力のものたち。しかし、人間は今や自らそれを作り出す地球上初の生命体になるかもしれません。🌏